Er is tegenwoordig veel te veel negativiteit en angstzaaierij rond AI. Het maakt niet uit welk nieuwsbericht er komt – als het maar over iets gaat Googlen Tweelingen krijgen een ‚herinnering‘ of ChatGPT Als je een gebruiker iets vertelt dat duidelijk verkeerd is, zal dat opschudding veroorzaken in een deel van de online gemeenschap.

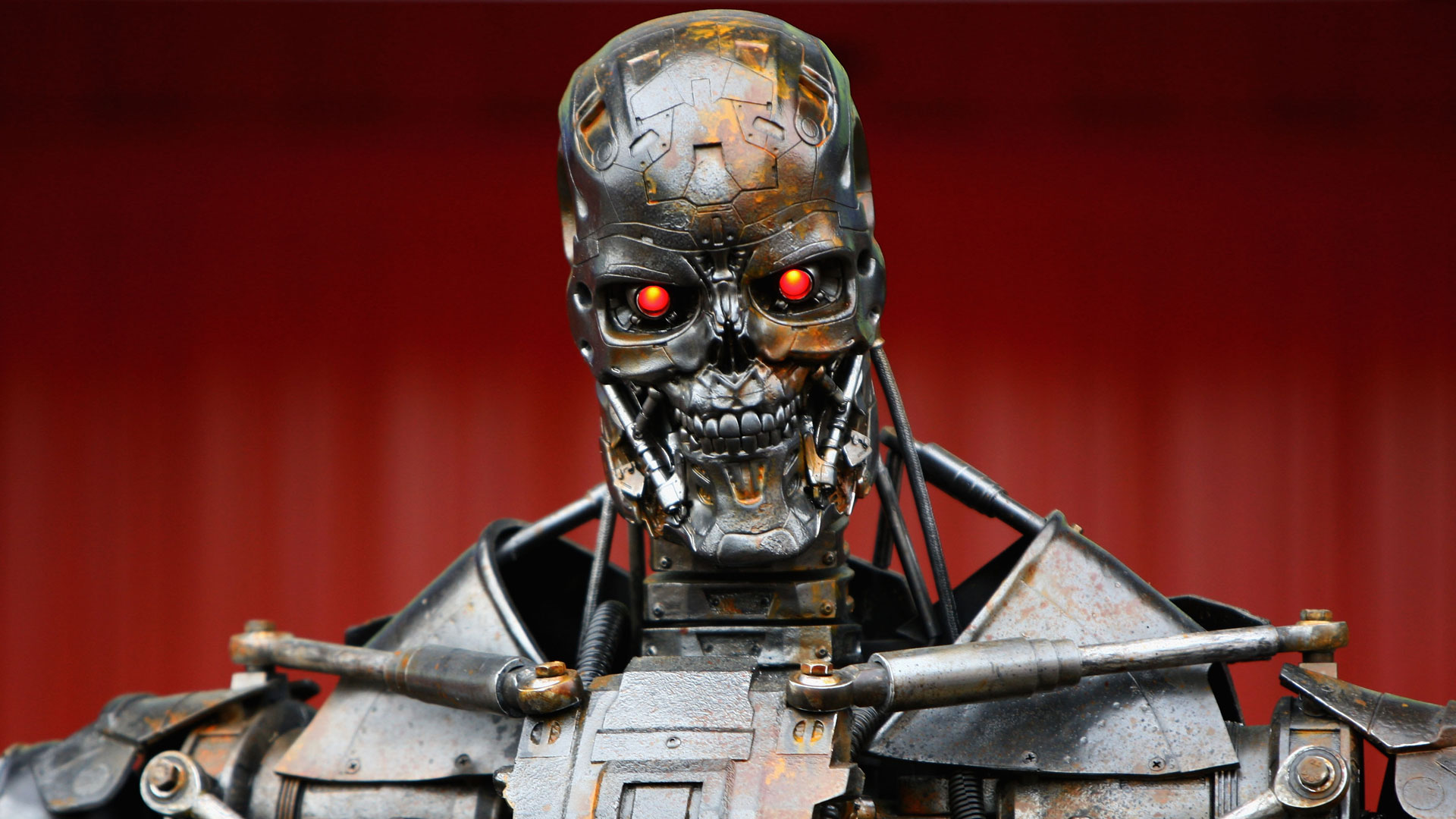

De aandacht die AI momenteel heeft met betrekking tot echte kunstmatige algemene intelligentie (AGI) heeft een bijna hysterisch medialandschap gecreëerd dat is opgebouwd rond visioenen van Terminator-fantasieën en andere doemscenario’s.

Dat is echter niet verrassend. Mensen houden van een goed Armageddon – ach, we hebben er de afgelopen 300.000 jaar genoeg over gefantaseerd. Van Ragnarok tot de Apocalyps tot de Eindtijd, en elke grote fantasy-blockbuster bezaaid met massavernietiging daartussenin, we zijn geobsedeerd. We houden gewoon van slecht nieuws, en dat is de trieste waarheid, om welke genetische reden dat ook mag zijn.

De manier waarop AGI tegenwoordig door vrijwel elke grote vocale uitlaatklep wordt geschilderd, komt grotendeels voort uit het idee dat het de allerergste van de mensheid is. Het beschouwt zichzelf uiteraard als een superieure kracht die wordt gehinderd door onbeduidende mensen. Het evolueert naar een punt waarop het zijn scheppers niet langer nodig heeft en onvermijdelijk een of andere vorm van een einde-van-de-wereld-gebeurtenis inluidt die ons allemaal van de aardbodem wegvaagt, hetzij door nucleaire vernietiging, hetzij door een pandemie. Of erger nog, het leidt in plaats daarvan tot eeuwige verdoemenis (met dank aan Roko’s Basilisk).

Er bestaat een dogmatisch geloof in dit soort perspectief bij sommige wetenschappers, media-experts, filosofen en grote tech-CEO’s, die er allemaal van de daken over schreeuwen, brieven ondertekenen en meer, en de kenners smeken om met AI te wachten. ontwikkeling.

Ze zien echter allemaal het grotere plaatje over het hoofd. Als ze de absoluut enorme technologische hindernissen buiten beschouwing laten die nodig zijn om zelfs maar dichter bij het nabootsen van iets dat ook maar enigszins in de buurt van de menselijke geest staat (laat staan een superintelligentie) te komen, slagen ze er allemaal niet in de kracht van kennis en onderwijs te waarderen.

Als een AI het internet binnen handbereik heeft, de grootste bibliotheek van menselijke kennis die ooit heeft bestaan, en in staat is filosofie, kunst en het hele menselijke denken tot nu toe te begrijpen en te waarderen, waarom moet het dan een of ander kwaad zijn? onze ondergang willen forceren in plaats van een evenwichtig en attent wezen? Waarom moet het de dood zoeken in plaats van het leven koesteren? Het is een bizar fenomeen, vergelijkbaar met bang zijn in het donker, alleen maar omdat we er niet in kunnen zien. We oordelen en veroordelen iets dat niet eens bestaat. Het is een verbijsterend stukje conclusie-springen.

Google’s Gemini krijgt eindelijk een herinnering

Eerder dit jaar introduceerde Google een veel grotere geheugencapaciteit voor zijn AI-assistent Gemini. Het kan nu details bevatten en ernaar verwijzen die u eraan geeft uit eerdere gesprekken en meer. Onze nieuwsschrijver Eric Schwartz schreef daar een fantastisch stuk over, dat je leest hiermaar het komt erop neer dat dit een van de belangrijkste componenten is om Gemini verder weg te brengen van een enge definitie van intelligentie, en dichter bij de AGI-nabootsing die we echt nodig hebben. Het zal geen geweten hebben, maar alleen al door patronen en geheugen kan het heel gemakkelijk een AGI-interactie met een mens nabootsen.

Diepere geheugenverbeteringen in LLM’s (Large Language Models) zijn van cruciaal belang voor hun verbetering – ChatGPT had eerder in zijn ontwikkelingscyclus ook zijn eigen gelijkwaardige doorbraak. In vergelijking is zelfs dat echter beperkt in zijn totale reikwijdte. Praat lang genoeg met ChatGPT en de opmerkingen die u eerder in het gesprek hebt gemaakt, worden vergeten; het zal de context verliezen. Dit breekt de vierde muur enigszins wanneer er interactie mee is, waardoor de beroemde Turing-test wordt getorpedeerd.

Volgens Gemini zijn de eigen geheugenmogelijkheden zelfs vandaag de dag nog steeds in ontwikkeling (en niet echt openbaar gemaakt aan het publiek). Toch gelooft het dat ze enorm superieur zijn aan die van ChatGPT, wat een aantal van die vierdemuur-illusiebrekende momenten zou moeten verlichten. Het kan zijn dat we momenteel een beetje een LLM AI-geheugenrace te wachten staan, en dat is helemaal geen slechte zaak.

Waarom is dit zo positief? Nou, ik weet dat het voor sommigen een cliché is – ik weet dat we deze term nogal vaak gebruiken, misschien op een heel nonchalante manier die de waarde van de term devalueert – maar we zitten midden in een eenzaamheidsepidemie. Dat klinkt misschien belachelijk, maar studies suggereren dat sociaal isolement en eenzaamheid gemiddeld kunnen leiden tot een toename van de sterfte door alle oorzaken met ergens tussen de 1,08 en 1,48x (Andrew Steptoe en co. 2013). Dat is verbazingwekkend hoog – een aantal onderzoeken hebben nu bevestigd dat eenzaamheid en sociaal isolement de kans op hart- en vaatziekten, beroertes, depressie, dementie, alcoholisme en angst vergroten en zelfs kunnen leiden tot een grotere kans dat een verscheidenheid aan vormen van kanker kan optreden. ook vasthouden.

De moderne samenleving heeft hier ook aan bijgedragen. De gezinseenheid, waarin generaties op zijn minst enigszins dicht bij elkaar leefden, verdwijnt langzaam – vooral op het platteland. Terwijl lokale banen opdrogen en de financiële middelen om een comfortabel leven te leiden onbereikbaar worden, trekken velen weg uit de veilige buurt van hun jeugd, op zoek naar een beter leven elders. Combineer dat met echtscheidingen, scheidingen en weduwe worden, en als gevolg daarvan blijf je onvermijdelijk achter met een toename van eenzaamheid en sociaal isolement, vooral onder ouderen.

Natuurlijk zijn er daarbij co-factoren, en op basis hiervan trek ik een aantal conclusies, maar ik twijfel er niet aan dat eenzaamheid een geweldige zaak is om mee om te gaan. AI heeft het vermogen om een deel van die stress te verlichten. Het kan hulp en troost bieden aan mensen die zich sociaal geïsoleerd of kwetsbaar voelen. Dat is het punt: eenzaamheid en afgesneden zijn van de samenleving hebben een sneeuwbaleffect. Hoe langer je zo bent, hoe meer sociale angst je ontwikkelt, en hoe kleiner de kans dat je in het openbaar uitgaat of mensen ontmoet – en hoe erger het in een cyclus wordt.

AI-chatbots en LLM’s zijn ontworpen om met u in contact te komen en te praten. Ze kunnen deze problemen verlichten en degenen die aan eenzaamheid lijden de kans geven om te oefenen in de omgang met mensen zonder angst voor afwijzing. Het hebben van een geheugen dat in staat is gespreksdetails vast te houden, is de sleutel om dat te verwezenlijken. We gaan nog een stap verder en AI wordt een bonafide metgezel.

Met zowel Google als OpenAI Door actief de geheugencapaciteit voor zowel Gemini als ChatGPT te vergroten, krijgen deze AI’s, zelfs in hun huidige vorm, de kans om Turing-testproblemen beter te omzeilen en te voorkomen dat die vierde muurbrekende momenten zich voordoen. Als ik even terugkom op Google: als Gemini inderdaad beter is dan de beperkte geheugencapaciteit van ChatGPT momenteel, en het meer als een menselijk geheugen fungeert, dan zou ik in dit stadium zeggen dat we het waarschijnlijk op het punt staan om het een echte nabootsing van een AGI, althans aan de oppervlakte.

Als Gemini ooit volledig wordt geïntegreerd in een slimme luidspreker voor thuis, en Google de cloudverwerkingskracht heeft om dit allemaal te ondersteunen (waarvan ik zou willen voorstellen dat het daar op aandringt gezien de recente ontwikkelingen op het gebied van de verwerving van kernenergie), zou het een revolutionair kunnen worden. kracht ten goede als het gaat om het terugdringen van sociaal isolement en eenzaamheid, vooral onder de kansarmen.

Maar dat is het punt: er zal een serieuze rekenkracht voor nodig zijn om dat te doen. Het runnen van een LLM en het bijhouden van al die informatie en gegevens is geen kleine taak. Ironisch genoeg kost het veel meer rekenkracht en opslagruimte om een LLM uit te voeren dan bijvoorbeeld om een AI-afbeelding of -video te maken. Om dit voor miljoenen of potentieel miljarden mensen te kunnen doen, zijn verwerkingskracht en hardware nodig die we momenteel niet hebben.

Angstaanjagende ANI’s

De realiteit is dat het niet de AGI’s zijn die mij angst aanjagen. Het zijn de kunstmatige beperkte intelligenties of ANI’s, die er al zijn, die veel huiveringwekkender zijn. Dit zijn programma’s die niet zo geavanceerd zijn als een potentiële AGI. Ze hebben geen idee van enige andere informatie dan waarvoor ze geprogrammeerd zijn. Denk aan een Elden Ring baas. Het enige doel is om de speler te verslaan. Het heeft parameters en beperkingen, maar zolang daaraan wordt voldaan, is het één taak om de speler te verpletteren – niets anders, en het zal niet stoppen totdat dat is gebeurd.

Als u deze beperkingen verwijdert, blijft de code bestaan en is het doel hetzelfde. In Oekraïne, toen Russische troepen stoorapparatuur begonnen te gebruiken om te voorkomen dat dronepiloten ze met succes naar hun doelen zouden vliegen, begon Oekraïne over te schakelen op het gebruik van ANI om in plaats daarvan militaire doelen uit te schakelen, waardoor het aantal treffers drastisch toenam. In de VS is er natuurlijk het legendarische nieuwsartikel over de AI-simulatie van de USAF (echt of theoretisch) waarin de drone zijn eigen operator doodde om zijn doel te bereiken. Je snapt het beeld.

Het zijn deze AI-toepassingen die het meest angstaanjagend zijn, en ze zijn er nu. Ze hebben geen moreel geweten of besluitvormingsproces in zich. Je bindt er een pistool aan en zegt dat hij een doelwit moet vernietigen, en dat zal precies gebeuren. Om eerlijk te zijn, mensen zijn net zo capabel, maar er zijn checks and balances om dat te stoppen en een moreel kompas (hopelijk) – toch ontbreekt het ons nog steeds aan concrete wetgeving, lokaal of mondiaal, om deze AI-problemen tegen te gaan. Zeker op het slagveld.

Uiteindelijk komt dit allemaal neer op het voorkomen dat slechte actoren misbruik maken van opkomende technologie. Een tijdje terug schreef ik een stukje over de dood van internet en hoe we een non-profitorganisatie nodig hebben die snel kan reageren en wetgeving voor landen kan bedenken tegen opkomende technologische bedreigingen die zich in de toekomst zouden kunnen voordoen. AI heeft dit net zo hard nodig. Er zijn organisaties die hier op aandringen, en de OESO is daar bijvoorbeeld één van – maar moderne democratieën en in feite elke regeringsvorm zijn gewoon te traag om op deze onmetelijk oprukkende bedreigingen te reageren. Het potentieel voor AGI is ongeëvenaard, maar we zijn er nog niet, en helaas is ANI dat wel.