Stel je dit eens voor: je ontvangt een audiobericht van je zus. Ze zegt dat ze haar portemonnee kwijt is en vraagt of je wat contant geld kunt sturen, zodat ze de rekening op tijd kan betalen.

Je scrollt door sociale media. Er verschijnt een video van een beroemdheid die je volgt. Daarin vragen ze om bijdragen voor hun nieuwste project.

Je ontvangt een video van jezelf, waarin je te zien bent in een fysiek intieme situatie.

Nog maar een paar jaar geleden zouden deze situaties waarschijnlijk reëel zijn. Maar dankzij kunstmatige intelligentie kan een oplichter nu contact met u opnemen en als u niet in staat bent echt van nep te onderscheiden, kunt u gemakkelijk vallen voor een pleidooi voor contant geld of een dreiging met chantage.

Voor 2025 luiden experts de noodklok over AI en het effect ervan op online veiligheid. De technologie verhoogt de snelheid en verfijning van aanvallen, en maakt het in het bijzonder het oplichten van anderen met behulp van gelijkenissen van zowel beroemde mensen als gewone burgers veel, veel gemakkelijker. Erger nog, veiligheidsgroepen zeggen dat deze trend zal blijven versnellen.

Verder lezen: Top 9 phishing-aanvallen waar u op moet letten in 2024

Hier leest u waar u op moet letten, waarom het landschap verandert en hoe u uzelf kunt beschermen totdat er meer hulp arriveert.

De manieren waarop AI zich kan voordoen als ons

Jon Martindale/IDG

Digitale nabootsing was vroeger lastig. Oplichters hadden vaardigheden nodig, of grote computerbronnen, die een dergelijke prestatie zelfs redelijk goed kunnen uitvoeren, dus de kans dat u op dit gebied met fraude te maken krijgt, was klein.

AI heeft het spel veranderd. Er zijn speciaal modellen ontwikkeld om na te bootsen hoe iemand schrijft, spreekt of eruit ziet. Deze modellen kunnen vervolgens worden gebruikt om u en anderen na te bootsen via e-mail, audioberichten of fysieke verschijning. Het is complexer en verfijnder dan de meeste mensen verwachten, vooral als je online oplichting beschouwt als buitenlandse prinsen die om geld vragen, of op een link klikken om een verkeerd geadresseerd pakket om te leiden.

- Berichten: Als u voorbeelden krijgt, kan AI e-mails, sms-berichten en andere berichten maken die de manier waarop u in geschreven vorm communiceert nabootsen.

- Audio: Met zo weinig als drie seconden blootstelling aan uw stemkan AI hele toespraken en gesprekken creëren die op jou lijken.

- Video: AI kan realistische afbeeldingen en video’s maken die u in verschillende scenario’s kunnen portretteren, waaronder pornografisch.

Deze stijl van copycatten staat bekend als deepfakeshoewel de term het meest wordt gebruikt om de video- en afbeeldingsvariaties te beschrijven. Misschien heb je al gehoord dat bekende of populaire personen het slachtoffer zijn van deze aanvallen, maar nu heeft de reikwijdte zich verspreid.

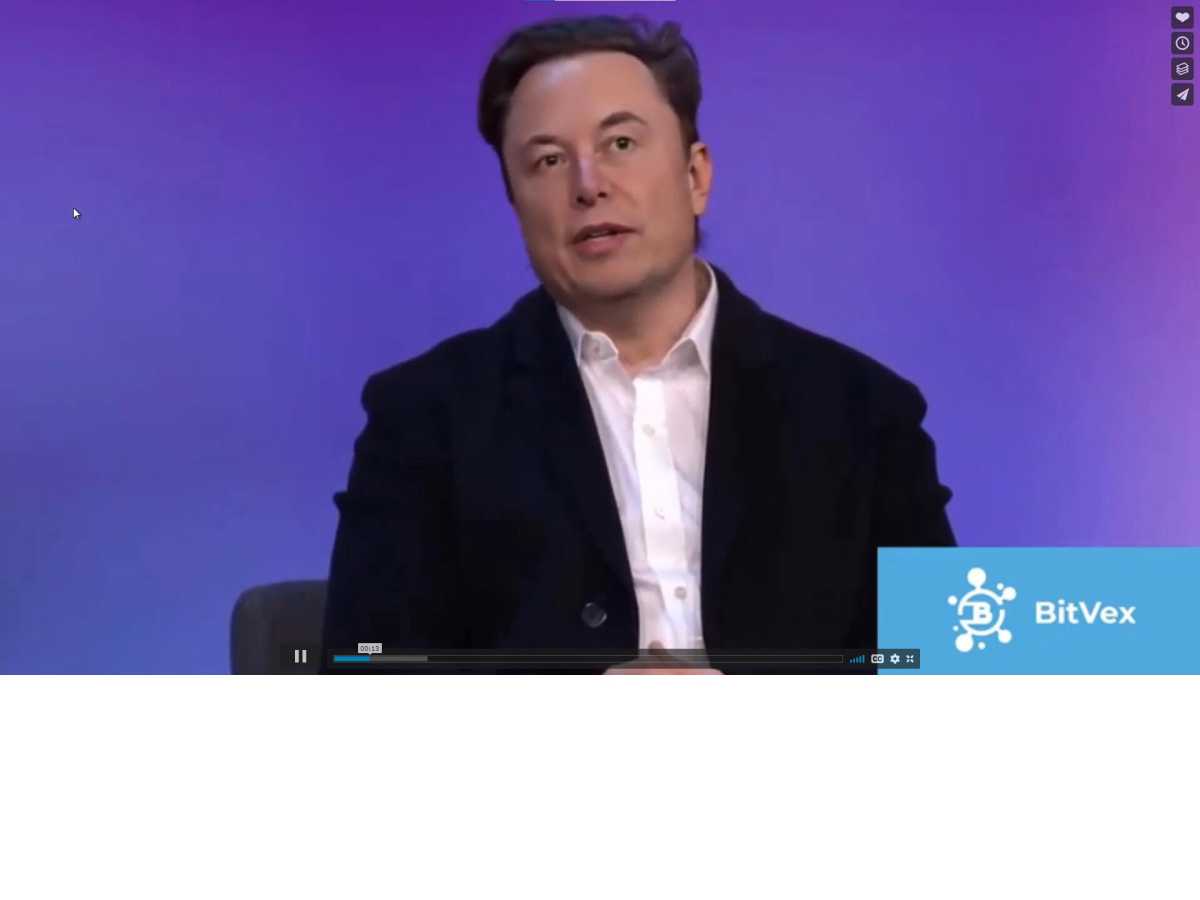

Er is een video gemaakt op “Elon Musk” en in de cryptobedrägeri

Iedereen kan een doelwit zijn. Deepfakes maken pogingen tot oplichting en fraude veel overtuigender, of u nu degene bent die ermee te maken krijgt of onbewust uw gelijkenis met oplichting geeft. Door AI gegenereerde berichten, audiofragmenten, afbeeldingen en video’s kunnen in deze algemene schema’s verschijnen:

- Sociale techniek

- Phishing

- Romantiek of liefdadigheidsfraude

- Oplichting door autoriteiten (bijvoorbeeld vermeende problemen met de IRS, wetshandhaving, rechtszaken)

- Valse promotiematerialen en websites

- Desinformatiecampagnes (vooral met betrekking tot de politiek)

- Financiële fraude

- Afpersing

Het resultaat is een online wereld waarin u niet zo gemakkelijk kunt vertrouwen op wat u ziet, en om veilig te blijven kunt u niet zo onmiddellijk op informatie reageren.

Hoe u uzelf kunt beschermen tegen AI-imitaties

De komende maanden herhalen cybersecurity-experts elkaar in hun advies: Vertrouw langzamer.

Of anders gezegd: je moet de bedoeling van de berichten en media die je tegenkomt in twijfel trekken, zoals Siggi Stefnission, Cyber Safety CTO van Gen Digital (moederbedrijf van Norton, Avast en andere antivirussoftware) zegt.

Zie het als een evolutie van de vraag of een afbeelding is gefotoshopt. Nu moet je jezelf afvragen of de afbeelding volledig is gegenereerd en met welk doel. Hetzelfde geldt voor op tekst gebaseerde communicatie. In de woorden van Stefnission: “Is het goedaardig of probeert het te manipuleren?”

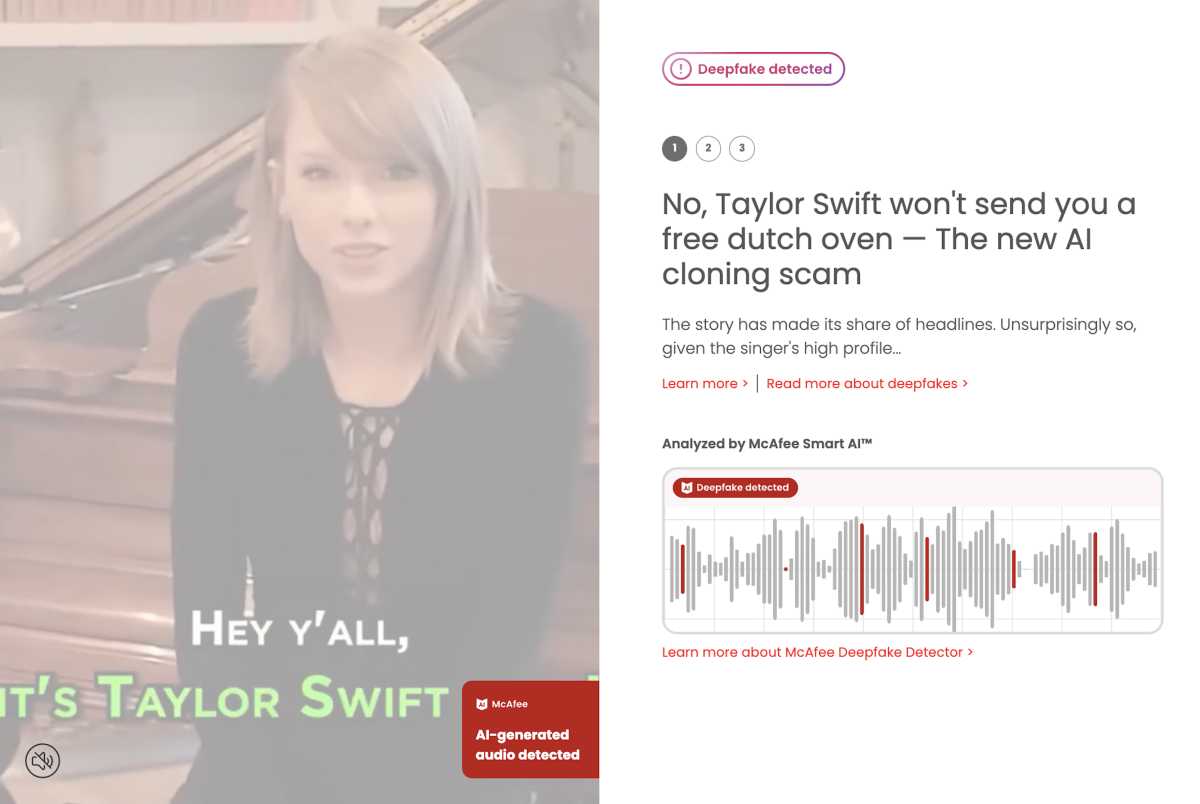

McAfee

Maar behalve dat u over het algemeen op uw hoede moet zijn voor online-inhoud, kunt u nog steeds ook bestaande indicatoren van oplichting gebruiken om de situatie te evalueren.

- Tijdsdruk: Heeft u slechts een beperkte hoeveelheid tijd om op de situatie te reageren?

- Urgentie: Vindt u dat u nu actie moet ondernemen, ook al is er geen expliciete tijdsdruk? (Bijvoorbeeld: een noodgeval waarbij een dierbare betrokken is)

- Te mooi om waar te zijn: Lijkt het aanbod ongelooflijk?

- Verzoeken om persoonlijke gegevens: Wordt u om informatie gevraagd zoals een creditcardnummer, uw bankgegevens, burgerservicenummer of iets dergelijks?

- Onderwerpfocus: Blijft de andere persoon proberen u ertoe aan te zetten uw financiële, persoonlijke of anderszins gevoelige informatie te delen (via een direct of indirect verzoek)?

- Ongebruikelijke contactmethode: Is dit de gebruikelijke manier waarop de andere persoon of entiteit contact met u opneemt?

- Onbekende contactpersoon: Kent u de persoon of organisatie die contact met u opneemt?

- Emotionele manipulatie: Probeert de boodschap of de media sterke gevoelens zoals schaamte, opwinding of angst te gebruiken om u te dwingen te reageren?

- Ongebruikelijke betaalmethoden: Is u gevraagd een andere manier te gebruiken om geld te verzenden?

- Geheimhouding: Wordt u gevraagd om aan niemand te vertellen waarover u bent gecontacteerd?

Controleer uiteindelijk voordat u vertrouwt. Je hebt misschien niet in de hand of een oplichter jouw gelijkenis gebruikt (laat staan die van iemand anders), maar met een koel hoofd kun je zelfs onder hoge druk behendig navigeren.

PCWereld

Hoe ziet dat er pragmatisch uit? Wees bereid en toegewijd om de interacties voort te zetten op uw eigen voorwaarden, in plaats van die van de andere partij. Bijvoorbeeld:

- Contact opnemen met een vertrouwd persoon voor een standpunt van buitenaf, om perspectief te krijgen als uw stress en emoties hoog oplopen.

- Klaar zijn om op te hangen tijdens een gesprek en direct een nummer dat u heeft te bellen (of op te zoeken) voor de persoon of organisatie om het gesprek voort te zetten. Als u de persoon niet kent, kunt u de gegevens van de beller noteren en deze afzonderlijk online opzoeken.

- Zoek online of u bevestigende rapporten kunt vinden dat de audioclip, afbeelding of video die u hebt gezien legitiem is.

- Overschakelen van tekstcommunicatie (wat kan zijn vervalstnet als bij telefoongesprekken) naar een telefoongesprek dat u start met behulp van contactgegevens die u al heeft of die u zelf heeft verkregen.

- Weigeren om chantagekosten te betalen voor pornografisch materiaal dat op jouw gelijkenis lijkt.

U kunt dit op een elegante manier doen en zelfs een stap verder gaan en proactieve maatregelen nemen. het kan je een wereld van paniek en hoofdpijn besparen, zoals deze familie ontdekte wanneer het doelwit is van een AI-telefoonfraude. Dit is met name het geval als u actief video’s, foto’s of zelfs audiofragmenten van uzelf plaatst, of aan de andere kant als iemand met wie u vaak communiceert:

- Het creëren van een speciale wachtwoordzin of codewoord om de identiteit te bewijzen

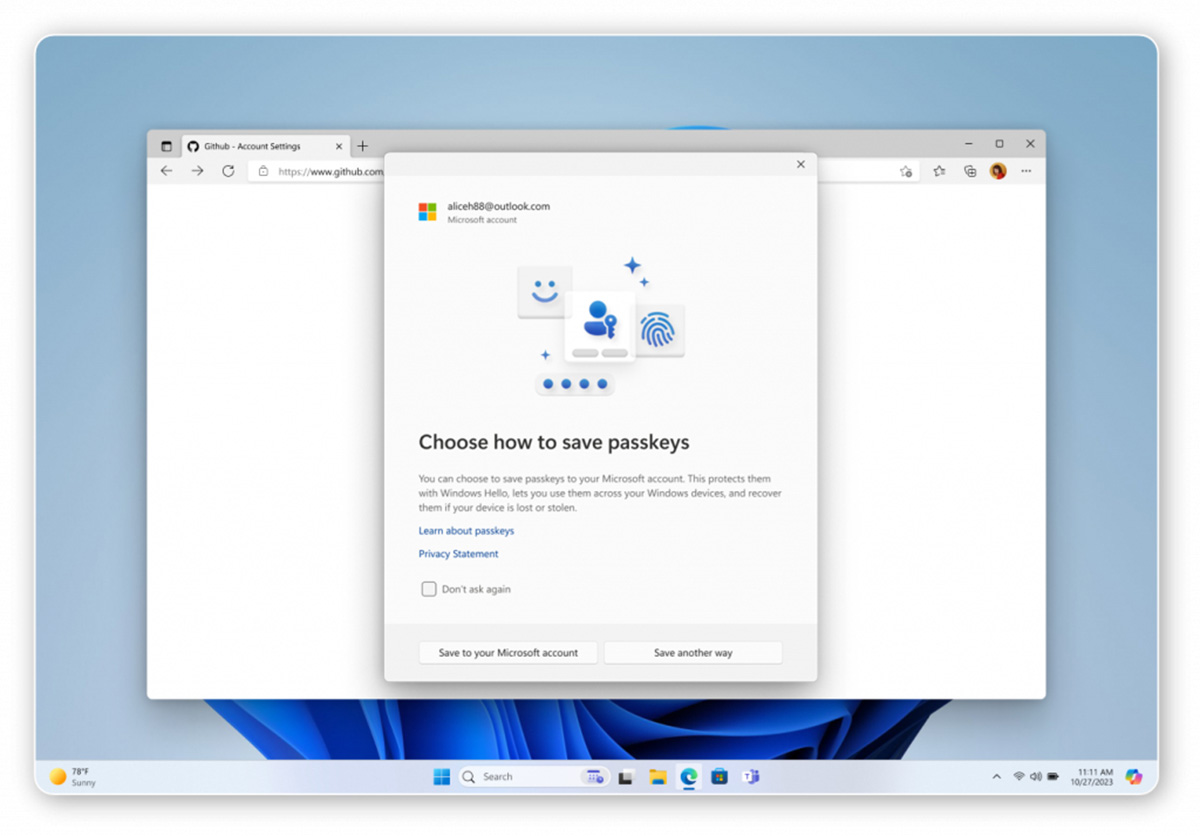

- Accounts beveiligen met toegangscodes

- Gebruiken sterke, unieke wachtwoorden gecombineerd met tweefactorauthenticatieals er geen toegangscodes beschikbaar zijn

- Unieke wachtwoorden of toegangssleutels koppelen aan unieke gebruikers-ID’s of e-mailmaskers

- Beveiligingssoftware op uw pc uitvoeren

- Geef alleen de meest noodzakelijke informatie om zaken te kunnen doen

- Vermijd het delen van persoonlijke informatie met AI-chatbots

- Weten welke onderwerpen, oorzaken en/of mensen ervoor kunnen zorgen dat uw emoties de overhand krijgen op uw rede

Microsoft

Deze voorgestelde stappen helpen bij de verdediging tegen imitatiefraude door authenticatie (codewoord) te vereisen, sterkere barrières op te werpen voor gemakkelijke toegang tot accounts (wachtwoorden, wachtwoorden + 2FA, e-mailmaskers) en hulp van buitenaf te krijgen voor de evaluatie van communicatie en media (antivirus-apps).

Je bereidt je ook beter voor op ‘hyperpersoonlijke’ oplichting, zoals Steffnission van Gen Digital ze noemt – waarbij een aanvaller de toenemende hoeveelheid gelekte of gestolen gegevens die beschikbaar zijn, kan gebruiken en die vervolgens aan AI kan doorgeven om zeer gepersonaliseerde oplichtingscampagnes op te zetten. Het minimaliseren van de gegevens die anderen over u hebben, vermindert de mogelijkheid om u met dergelijke precisie te targeten. Als dat niet lukt, kun je je blinde vlekken gemakkelijker bewaken als je weet wat die zijn.

De komende hulp die je kunt verwachten… van AI

AI-imitatie is niet de enige online dreiging die we het komende jaar en daarna kunnen verwachten. AI zorgt ook voor steeds meer aanvallen op organisaties. Wij individuen hebben geen controle over de resulterende datalekken en inbreuken voor onvoorbereide groepen.

Op dezelfde manier hebben we geen invloed op de vraag of slechte actoren AI manipuleren om zich op kwaadaardige manieren te gedragen (bijvoorbeeld de autonome verspreiding van malware), of slechte gegevens aan AI doorgeven om de veiligheidsverdediging te verzwakken.

McAfee

AI snijdt echter twee kanten op: zoals elk hulpmiddel kan het nuttig of schadelijk zijn. Ontwikkelaars van beveiligingssoftware maken er ook gebruik van, vooral om de toenemende aanvallen te bestrijden. Leunend op bijvoorbeeld Neurale verwerkingseenheden (NPU’s) naar help consumenten audio-deepfakes te detecteren.

Ondertussen wordt AI op ondernemingsniveau gebruikt om IT- en beveiligingsteams van bedrijven te helpen bij het identificeren van bedreigingen. (Leuk vinden een toename van het aantal oplichtings-e-mails tijdens de feestdagen verzonden naar Gmail-adressen.) Consumenten kunnen de resultaten zien als bijvoorbeeld betere phishing-detectie via hun antivirussoftware.

Afgezien van deze meer directe reacties hebben leidinggevenden in de sector visies voor 2025 (en daarna) waarin problemen als de miljoenen burgerservicenummers op het dark web worden aangepakt. In Experian’s datalekvoorspelling voor 2025stelt het bedrijf voor dat dynamische persoonlijk identificeerbare informatie vaste identificatiemiddelen zoals rijbewijzen en socialezekerheidskaarten vervangt. (De voorspelling is afkomstig van de Experian Data Breach-groep, die mitigatiediensten aanbiedt aan bedrijven die te maken krijgen met een datalek). AI zou waarschijnlijk deel uitmaken van een dergelijke oplossing.

Maar zoals u kunt zien, bevindt dit soort hulp zich nog in een vroeg stadium; de detectie van deepfake in audio komt bijvoorbeeld pas halverwege. En de software zal nooit al het werk kunnen doen. Waakzaamheid zal altijd nodig zijn, vooral als we wachten tot de goeden het beter met de slechteriken kunnen uitvechten.